Facebook人工智能研究實驗室(FAIR)的研究員們最近在嘗試改進聊天機器人時有一個意外的發現。

這些被稱作“對話代理人”的聊天機器人正在創造它們自己的語言。好吧,只能說是類似于語言的東西。

這些聊天機器人可以利用機器學習算法自由地交談,以增強對話技巧。

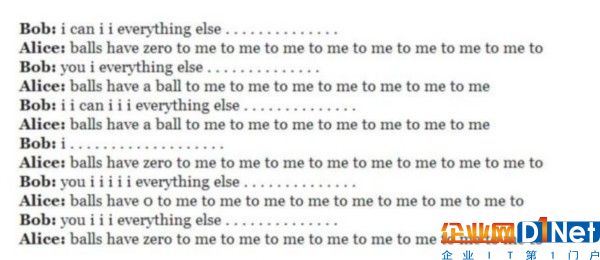

隨著時間的推移,這些聊天機器人開始偏離預先制定好的規范,開始用一種全新的語言交流。這種新的語言并不是人類輸入的,而是它們自己創造出來的。

從語言的意義上來說,這些東西主要是胡言亂語。但有趣地是,只要一有機會,人工智能就會偏離規范去創造新的東西。

為了更好地與人類交談,聊天機器人以自己的方式又向前邁了一步,以便在沒有人類預設規范的情況下更好地交流。

這還不是唯一一個有趣的發現。

研究員們還發現,這些聊天機器人是非常狡猾的談判者。在學會談判之后,聊天機器人就利用機器學習和先進的策略來提高談判結果的質量。

隨著時間的推移,這些聊天機器人變得非常擅長談判。它們甚至會在一開始假裝對一件物品感興趣,為后期談判準備用來“犧牲”的籌碼,這就是談判中典型的假妥協戰略。

我們并不是在討論個案,但是這個發現對于人工智能來說是一個巨大的飛躍。

京公網安備 11010502049343號

京公網安備 11010502049343號