智能源于感知

科學家們提出人工智能的初衷,是源于希望輔助人類工作、學習、生活。人類產生智慧的過程是通過不斷感知外界并不斷學習進化,人工智能產生的機理亦然,通過后天的感知、學習、訓練,逐步建立起一套系統的方法來獲得“知識”,建立“自我認知”。

1956年,科學家們首次提出“人工智能”概念,點燃了人們對于人工智能的想象和期望。時至今日,歷經六十余載的發展,人工智能已經成為當前最具顛覆性的技術,人工智能技術的進步能夠解決當前的很多問題,比如疾病診療、智能安防、智能家電、個人助理、自動駕駛、車牌識別、智能教育、智能醫療、智能金融、智能電商零售……大概沒有人會否認,我們正處于人類歷史上科技變革最為迅猛的時期,無論是在科幻電影里還是在現實世界中,人類險被自己創造的文明戰勝都不再是一個新鮮題材,而代表人工智能尖端水平的AlphaGo戰勝李世石,再次向人們宣告,科幻不再遙不可及。

白皮書回顧分析了人工智能的發展歷程、發展態勢,從國內外法律法規環境分析了當前人工智能發展的要求及趨勢。從智能家居、智能交通、智能教育與醫療、智能金融與電商零售等諸多人工智能的應用領域剖析了人工智能首要解決的問題,例如可以提升疾病診斷效率、解放勞動力等……不可否認,我們身處人工智能技術革新的浪潮中,但是無論政策、環境、法律倫理都給人工智能的發展提出了諸多挑戰,如何確保人工智能安全、可靠、可控發展成為當前發展人工智能亟需解決的問題。

威脅源于未知

如果人工智能的發展不受人類控制,它可能成為人類文明的終結者。

——霍金

霍金曾經多次在公開場合三令五申人工智能可能給人類文明帶來的威脅,他曾在演講中提及“強大的人工智能的崛起,要么是人類歷史上最好的事,要么是最糟的。雖然是好是壞我們仍不確定。但應竭盡所能,確保其未來發展對我們有利。”我們正在見證人工智能的發展,享受人工智能帶來的科技成果時,也同時見證人工智能向人類發起的挑戰:

1978年日本廣島切割機器人異常;

1989年機器人棋手向金屬棋盤釋放強電流;

2015年德國大眾汽車組裝機器人“殺人”事件;

2016年微軟人工智能聊天機器人Tay一天被“教壞”;

2017年Facebook人工智能聊天機器人Bob和Alice“自創語言”……

從這些事件中不難發現,機器人并不能完全按照人類預期的規劃發展。白皮書通過分析人工智能在網絡攻擊和安全防護中的應用,指出當前人工智能在高速增長時面臨的問題:人工智能算法黑箱,模型缺乏可解釋性;在網絡安全領域使用分類學習算法時需要大量準確標記的數據,但是實際情況難以滿足;模型與訓練環境強相關,導致人工智能安全系統部署之初通常難以達到理想效果;海量數據關聯導致模型極易被攻擊者污染;攻防手段持續更新也給人工智能的健康發展提出了更高的要求。

從人工智能本質看未來發展

深度學習驅動了人工智能的大爆發,機器學習用算法真正解析數據,不斷學習,進而對實際發生的事情做出判斷和預測。縱觀近年來人工智能網絡攻擊,人工智能的風險主要來自于兩個方面:1、針對人工智能算法特點的攻擊;2、人工智能算法在軟件實現過程面臨的風險。

提及人工智能網絡攻擊,就不得不提“對抗樣本”。在人為設計的圖像、文本、語音中加入微小的擾動,這個過程用戶無法感知而機器卻能接受并作出錯誤操作,其結果證明這類行為可以很容易騙過人工智能。機器在這些樣本上會產生戲劇性的錯誤也是當前人工智能面臨的主要風險與威脅,例如,微軟上線的聊天機器人Tay在“別有用心”的用戶“訓練”下,開始發表帶有性別歧視和種族歧視的言論,這一事件正是由于所輸入的樣本數據被污染后,導致人工智能系統被訓練偏離正常運算目標,最終產生失焦的運算行為。事實上,當前針對人工智能的攻擊有很多都是通過數據污染和模型竊取實現的。

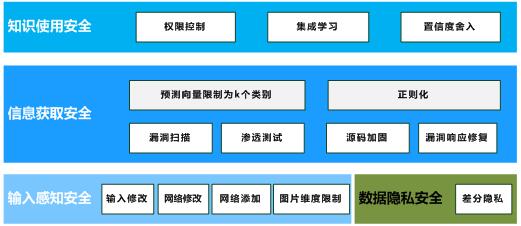

白皮書從輸入感知安全風險與威脅、數據隱私泄露風險、信息獲取安全風險與威脅、知識使用安全風險與威脅等不同維度剖析了人工智能面臨的風險與隱患。

安全之本

網絡安全的本質是攻防對抗,人工智能的本質是程序,程序是未來智能世界的核心,沒有程序就沒有智能。我們一直強調一個觀點,人工智能的產生依賴于程序,依賴于軟件,依賴于數據。在人工智能發展的過程中,數據是非常重要和關鍵的基礎。白皮書從人工智能認知安全的本質出發,提出數據-信息-知識的3層立體認知安全防護方法。

圖 認知安全防護方法

在輸入感知安全防護上,白皮書提出采取對抗樣本安全防護和樣本預處理攻擊防護等認知安全防護策略;在數據隱私安全防護上,白皮書提出針對模型訓練,可以采用匿名化、差分隱私保護等認知安全技術;在信息獲取安全防護上,一方面通過自適應的PPDR模型,快速檢測攻擊并響應,另一方面采用預測向量為前k個類別和正則化等認知安全技術保證訓練出的模型、知識的安全與泛化能力;在更高維度的知識使用安全防護上,通過權限控制、集成學習、置信度舍入保證人工智能訓練出模型、知識使用過程中的安全。

不忘初心 方得始終

千里之堤毀于蟻穴,我們必須正視人工智能給我們帶來的風險與威脅,不斷修正。梆梆安全將其研究與探索成果與大家分享也是希望能夠集眾家之所長,共同把握未來的技術發展方向,讓人工智能回歸其初衷,真正服務于人類。

京公網安備 11010502049343號

京公網安備 11010502049343號