新聞摘要:

· 思科《2024年數據隱私基準研究報告》顯示,大多數企業因數據隱私和安全問題限制使用生成式人工智能(GenAI)。27%的企業到目前為止,暫時禁止使用生成式人工智能。

· 48%的企業承認在生成式人工智能工具中輸入了非公開的公司信息。

· 91%的企業意識到需要采取更多措施,向客戶保證他們的數據在人工智能中僅用于有預期的合法目的。

· 98%的企業表示外部隱私認證是影響其購買決策的重要因素,這一數據達到近年來的最高水平。

2024年3月22日,北京——日前,思科發布了《2024年數據隱私基準研究報告》,該報告是對企業關鍵隱私問題及其業務影響的年度全球調研。調研結果體現了面對生成式人工智能,人們對隱私與日俱增的擔憂,企業在使用人工智能時所面臨的信任挑戰,以及隱私保護領域的誘人投資回報。根據12個地區2600名隱私和安全專業人士的反饋,該基準研究報告顯示,隱私問題遠不止是合規性問題。

生成式人工智能技術下企業對隱私的擔憂與日俱增

思科首席法務官 Dev Stahlkopf 表示:“生成式人工智能對企業來說是一門完全不同的科技,它帶來了引人深思的新挑戰。90%以上的受訪者認為人工智能需要數據和風險管理的新技術,公司的治理需要更加嚴密周到,維護客戶的信任取決于此。”

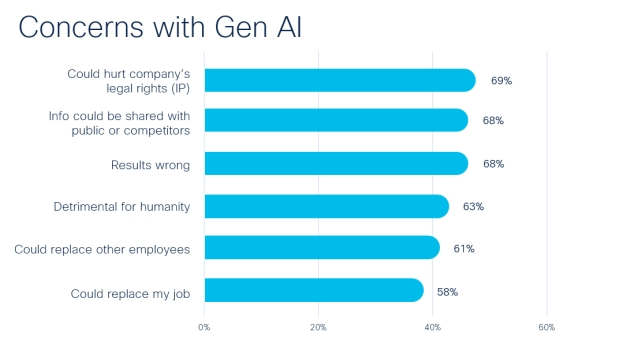

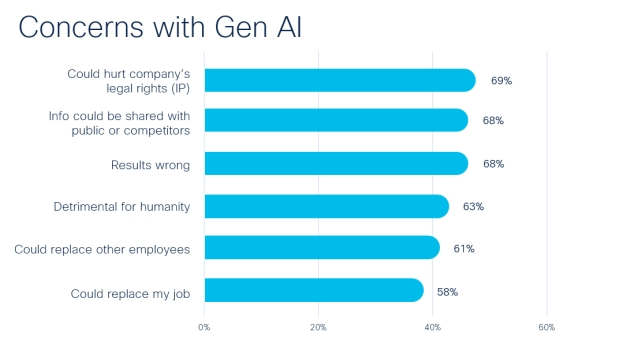

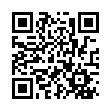

報告顯示,企業最關注的問題包括對企業的法律和知識產權的威脅(69%),以及向公眾或競爭對手泄露信息的風險(68%)。

對生成式人工智能的擔憂

大多數企業都意識到了這些風險,并采取了限制措施:63%的企業對可輸入數據的內容設置了限制,61%的企業對員工可以使用的生成式人工智能工具設置了限制,27%的企業表示暫時禁止使用生成式人工智能應用程序。盡管如此,許多用戶還是在生成式人工智能中輸入了可能存在風險的信息,包括員工信息(45%)或公司的非公開信息(48%)。

人工智能和透明度進展緩慢

如今,消費者對使用涉及其數據的人工智能感到擔憂。91%的企業認識到,他們需要采取更多措施向客戶保證,他們的數據在人工智能中僅用于有預期的合法目的。該數據與去年的水平相似,表明企業在該維度上沒有取得太大進展。

在建立消費者信任方面,企業與個人的關注點各有側重。消費者的優先級是獲得明確的信息,清楚地了解其數據如何被使用,以及數據是否會出于營銷目的而被售賣。企業方的優先級是遵守隱私保護法(25%)和避免數據泄露(23%)。這表明,企業可更多關注透明度的問題——尤其是在人工智能應用方面,因為消費者可能很難理解算法是如何做決策的。

隱私與信任:外部認證和法律的作用

企業認識到有必要讓客戶放心,了解他們的數據是如何被使用的。

思科副總裁兼首席隱私官Harvey Jang表示:“94%的受訪者認為,如果他們不能充分保護數據,消費者就不會購買他們的產品。98%的受訪者表示,外部隱私認證是影響消費者購買決策的重要因素,因此他們正在尋找企業值得信賴的確鑿證據。這些數據是我們多年來在思科隱私研究中看到的最高值,再次證明了隱私保護已經與客戶的信任度和忠實度密不可分。在人工智能時代情況更是如此,對隱私保護進行投資可以使企業更有道德、更負責任地應用人工智能。”

思科大中華區副總裁、安全事業部總經理卜憲錄表示:“從研究報告數據上看,對于消費者關心的隱私和數據安全保護,企業還需要采取更多措施。思科在人工智能、網絡安全領域有其獨特優勢,除了在產品和技術方面多年的投入,不斷地創新,思科秉持‘負責任AI’的原則,堅持透明、公平和負責任的企業行為準則,在幫助企業提高生產力,促進業務創新的同時,充分做好隱私保護和數據安全保障措施,贏得消費者信任。”

盡管隱私保護規定可能會給企業增加更多成本和要求,但80%的受訪者表示,隱私保護規定對企業產生了積極影響,只有6%的受訪者表示影響是負面的。強有力的隱私保護規定增加了消費者的信心,愿意信任企業,對其分享數據。

此外,許多政府和企業正在制定數據本地化規定,以便將某些數據保留在該國家或地區內。雖然大多數企業(91%)認為,如果將數據存儲在本國或本地區,其數據本質上會更安全,但86% 的企業也表示,與本地供應商相比,規模化運營的全球供應商能更好地保護其數據。

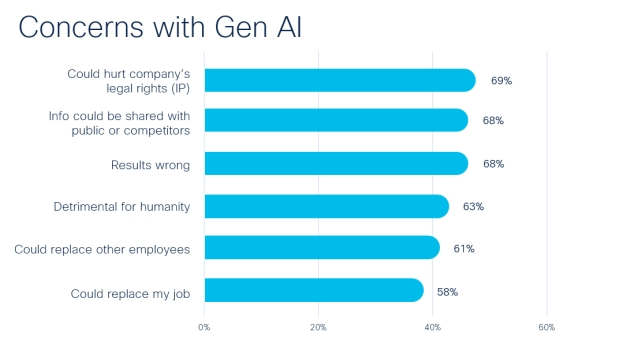

隱私保護:極具價值的投資

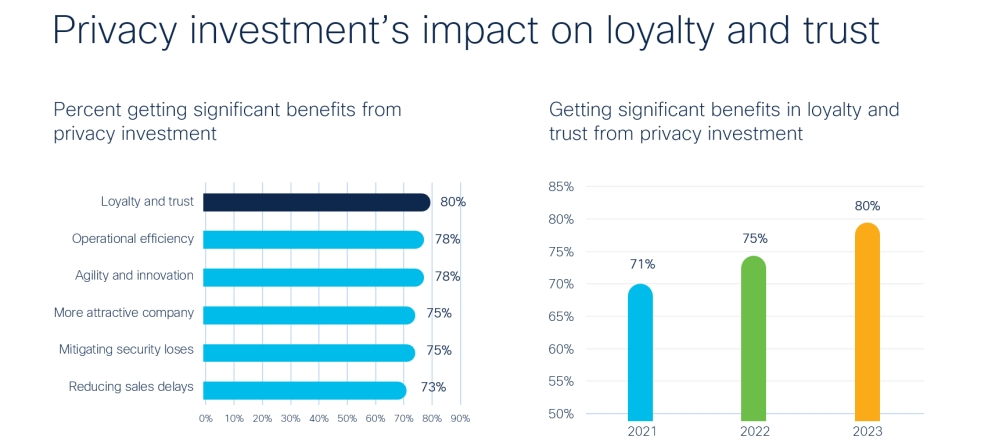

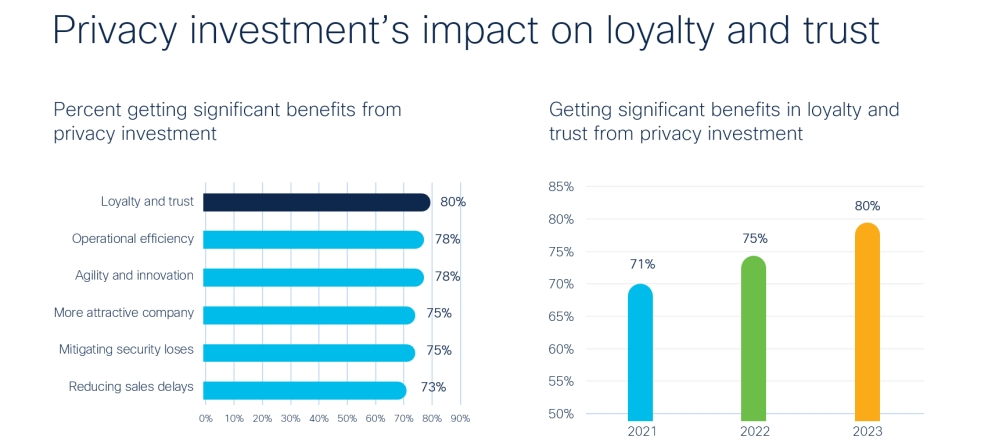

過去五年中,企業在隱私保護方面的支出增加了一倍多,收益呈上升趨勢,保持強勁回報率。今年,95%的企業表示隱私保護的收益超過了成本,平均每個企業的隱私保護收益是其支出的1.6 倍。此外,80%的企業表示從隱私保護方面的投資中獲得了顯著的“忠實度和信任度”,而在隱私保護投資最成熟的企業中,這一比例甚至更高(92%)。

在隱私保護方面的投資對忠實度和信任度的影響

2023年,大型企業(擁有1萬名以上員工的企業)的隱私保護支出比去年增加了8%到9%。然而,規模較小的企業在這一方面的投資則有所減少,例如,員工人數在 50-249之間的企業,其隱私保護方面的投資平均減少了四分之一。

掃一掃

掃一掃

京公網安備 11010502049343號

京公網安備 11010502049343號