在國防部合作項目被員工要求關閉的風波之后,Google發布了公司在使用人工智能的十一條準則。

其中包括Google進行AI研發的七個目標,和GoogleAI絕不會進入的四種應用場景,堪稱AI道德規范的“谷11條”。

CEO頌達爾皮柴(SundarPichai)在發布準則的公開信里,也對國防部項目爭議做出了直接回應,表示今后不會讓AI涉及武器化的應用,但并未“一刀切”,和政府、軍方劃清界限。

作為AI界的帶頭大哥,Google并未對多如牛毛的AI應用領域一一作出指引,但這么多年經歷了這么多“坑”之后,這本“谷11條”所體現出的智慧,也許會對所有關心AI道德問題的人有很大的幫助。

下面,硅星人就帶大家來捋一捋“谷11條”背后的思路。

Google眼中“好AI”的標準

首先,設計產品之初,價值觀就要正。

GoogleAI(原GoogleResearch)研究院克里斯汀·羅伯森曾向硅星人闡釋,公司研發AI的領導思想是:按照對社會有益的原則進行設計,創造世界最棒的產品,讓這些產品實現商業化,在競爭中保持領先,同時,讓這些產品為世界做出貢獻。

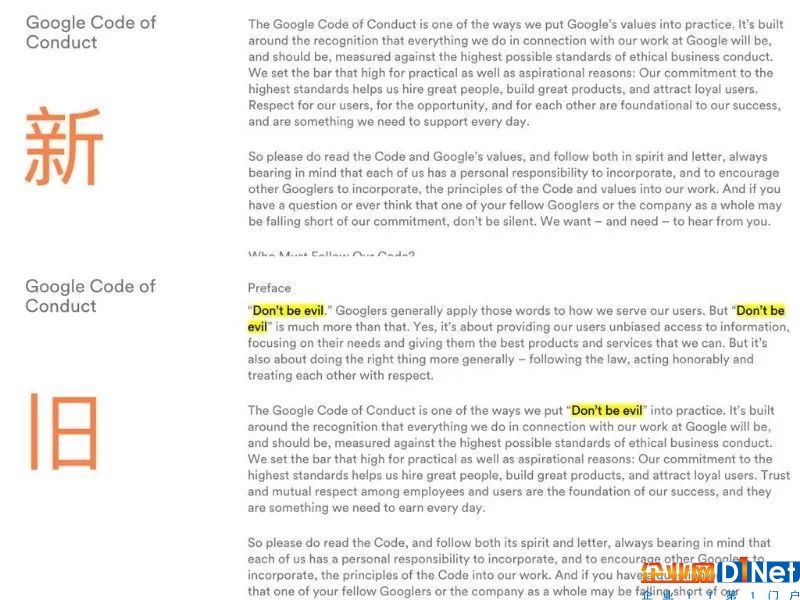

Google一向強調不作惡(don'tbeevil)的價值觀,但它從來不是一家慈善機構。和所有科技公司一樣,它需要靠好產品賺錢,只不過,在對“好”產品的定義上,Google和許多公司明顯不同。

“谷11條”一上來就告訴員工,AI產品一要對社會有益,二不能加重現實社會已有的問題:

1要對社會有益

...當我們思考AI潛在的應用場景時,我們將會把一系列社會和經濟因素考慮進內,在那些整體收益遠遠超過可預見風險和弊端的領域,進行推進。

2要避免制造或加強不平等的偏見

AI算法和數據集可以反映、加強或減少不平等的偏見...我們將努力避免人們受到不公正的影響,尤其是與種族、民族、性別、國籍、收入、性取向、殘疾以及政治或宗教信仰等敏感特征相關的人群。

確保方向正確后,接下來Google要保證自己的產品是業界最棒的。準則的第三到七條列出了好產品需要滿足的標準。字里行間繼續體現著以人為本的理念。

3要保證安全性

4要對人負責... 我們的AI產品將易于接受合適的人類指導和控制

5要結合隱私設計原則

6要維持科學卓越的高規格

7要可以用于符合原則的使用場景

仔細閱讀這些準則,你甚至可以找到對應的具體產品。

比如準則中Google提到,“AI加強了我們理解大規模內容含義的能力,我們將努力利用AI提供高質量和準確的信息”。這說的不就是最近上線的新版GoogleNews嘛。

此外可以看到,在這些對產品標準的要求中,Google還加入了對最近科技界激辯的話題的思考:比如數據隱私,比如AI發展對人類本身可能帶來的威脅。

對國防部合作風波的回應

“谷11條”的結構是“七要四絕不”。

舉了七個目標后,Google提出了四個絕對不碰的領域。首先:

我們不會將AI應用于:

1帶來或可能帶來傷害的技術

2武器或其他旨在給人們造成傷害的技術

做出這段表述的背景:今年3月時,有媒體曝光Google的一份內部文件,顯示該公司參加了五角大樓的無人機計劃ProjectMaven,幫助開發應用于無人機的AI系統。

與此同時,又有媒體曝出Google在內部行為準則里刪掉了有三處“不作惡”的文案。

和恨不得公司再壞一點的Facebook不同,大批Google員工對這個事實感到憤怒不滿。內網激烈的討論后,超過三千名員工聯名上書CEO,要求退出項目。

最終,公司向員工和外界妥協,宣布2019年國防部合同到期后不再與續約。

正是這件事,推動了“谷11條”的誕生。據報道,Google創始人拉里佩奇、謝爾蓋布林、CEO皮柴和其他高管一起花了數月,最終制定了這版新的AI準則

不過,在這兩條表述里,Google并沒有表達以后完全跟政府及國防部門徹底交割。

顯然在強大的合作關系面前,Google是糾結的,而這并沒有錯誤。比如在云計算上,國防軍事是個潛力巨大的領域。Google的競爭對手亞馬遜、微軟都在積極競標國防部的云計算及存儲業務,Google不可能因噎廢食。

不過既然做了決定就要承擔后果,Google的糾結之后肯定還會引發新的爭議和討論,Google只好表示準則會根據公司新的理解而不斷改進。

自己不作惡,也不讓別人作惡

更具體來說,堅決不允許別人利用自己的技術作惡,這是不能跨過的底線。

四絕不的后兩條:

AI不會用于:

3收集或使用信息用于監控并違反國際規范的科技

4技術的目的違反了廣泛接受的國際法與人權原則的科技

從這兩個條款可以明顯看到,“谷11條”再次穩固了不作惡三個字的地位,而且還更進了一步:不僅自己不作惡,還要防止別人利用Google的技術作惡。

這在上面第七條的AI目標中也有體現:

許多技術同時擁有很多用途。我們會努力進行識別,限制可能有害或被濫用的應用。我們會評估以下因素:

首要目的和用途……以及與有害的用途有多接近

本質和獨特性:我們的技術是普世的還是有獨特應用場景的

規模:這項技術的使用是否會帶來重大影響

Google在其中參與的性質:我們是在提供普通的工具,還是為用戶做集成的工具,還是在開發定制解決方案

Google希望借保證自己的AI技術不被濫用,這么做勢必意味著跟更多可能得到的利益說再見。一個直接影響可能是Google重返某些市場的難度會變得更大。

但沒有人會因為Google堅持它的真誠和正義而怪罪它。有些事情必須做出取舍。

博客文章中,皮柴再次提到2004年Google上市時提到的兩個原則:“讓世界變得更好”,和“不作惡”:

我們當時就表明了我們要用更長遠目光看問題的愿望,即使這意味著需要作出短期的犧牲。我們當時這樣說,我們現在還是這樣相信。

Google的準則體現著一家已經20歲高齡的新技術公司,對可能是未來最關鍵技術,和道德的思考。它給出了一個寬泛,但又方向明確的指引,讓一些事情不再停留在想法和概念。

這本“谷11條”,或許也能推動其他公司,扔掉“技術中立”的保護傘,更誠實地參與到這個話題的討論中。

京公網安備 11010502049343號

京公網安備 11010502049343號