7月9日,由中國發展研究基金會與微軟公司聯合撰寫的《未來基石——人工智能的社會角色與倫理》報告在北京發布。

報告稱:“如果我們決心要利用人工智能帶來的無限機遇,最好在沖進未知之門之前給這輛汽車裝上剎車,讓它真正能行穩致遠。這個剎車就是倫理規范和公共政策準則。”

在深度學習、云計算以及芯片、傳感器技術的幫助下,人工智能成為馬力驚人的社會發展加速器,帶著全球向充滿不確定性的未來疾馳。但在高速發展的過程中,一些擔心也隨之而來。

例如,人工智能技術是否會擴大貧富差距;如何確保人工智能技術不會武器化,如何防止某些公司對技術的濫用等。

在國家層面,人工智能的倫理問題已經引起了越來越多的關注,出臺了一系列的政策指引和準則。日本的一個跨專業團體曾發布《下一代機器人安全問題指導方針(草案)》,韓國政府早在2007年就著手擬訂《機器人道德憲章》,美國信息技術產業委員會(ITI)也于2017年頒布了人工職能的14條政策準則。最近,歐盟出臺了史上最嚴格的史上最嚴格數據保護條例——《通用數據保護條例》(General Data Protection Regulation,簡稱GDPR),旨在加強對數據的保護。

在公司層面上,硅谷的一些巨頭科技公司深有感觸。此前,由于和美國國防部有軍方合作項目,亞馬遜、微軟、谷歌等公司遭到外界的詬病。有媒體指出這些公司正利用人工智能技術助紂為虐,是在作惡。尤其是谷歌的Maven項目(編注:該項目主要指谷歌利用機器學習技術幫助美國國防部分析無人機視頻,識別物體),這個人工智能項目受到公司內部和外部的指責,谷歌內部甚至出現了離職潮。

在內外輿論的壓力之下,谷歌公司已經申明,在人工智能開發應用中,堅持包括公平、安全、透明、隱私保護在內的7個準則,并明確列出了谷歌“不會追求的AI應用”。

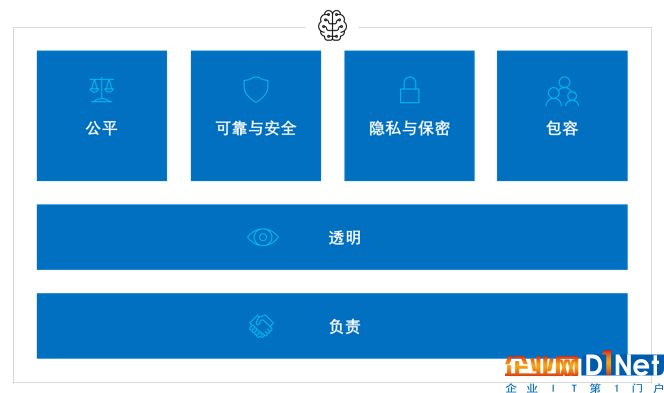

在今天發布的報告中,微軟也給出了自己的答案,提出要設計出可信賴的人工智能,必須采取體現道德原則的解決方案,因此提出6個道德基本準則,包括公平、包容、透明、負責、可靠與安全、隱私與保密。其中,透明和負責是其他四項原則的基石。

微軟提出的6個道德基本準則

具體原則為:

公平:人工智能系統應當以公正、一致持平的態度對待每一個人,而不能對情況類似的群體施以不同的影響。

可靠:人工智能系統應確保運行可靠、安全,避免人工智能系統可能會在不可預見的情況下造成傷害,或者被人惡意操縱,實施有害行為。

隱私與保密:人工智能系統應當有保障且尊重隱私,這是贏得公眾必要信任的條件,而公眾信任又是充分利用人工智能的前提。

包容:人工智能系統應確保人人賦能、人人參與。要確保人工智能技術造福、賦能每一個人,這些技術必須考慮并解決廣泛的人類需求和經驗。

透明:人工智能系統應易于理解。一旦人工智能系統被用于做出影響人們生活的決策,人們就有必要了解人工智能是如何做出這些決策的。

負責:與其他技術和產品一樣,設計和部署人工智能系統的人員必須對其系統的運行負責。

除了提及人工智能在倫理道德方面的發展約束外,這份報告中,也對中美兩國人工智能發展情況進行了描述。

報告認為,美國和中國在人工智能領居于全球前列。目前,全球人工智能領域最有影響力的大學和企業主要分布在美國,在核心人才的培養上也是如此。從累計的專利數量和研究論文數量看,美國遙遙領先于世界其他國家,中國則在數量增長上后來居上,但質量上與美國還有較大的距離。

在產業層面,美國和中國也居世界前兩位。截止2017年6月,全球2542家人工智能企業中,美國有1078家,占42%,中國592家,占23%,其余872家企業分布在瑞典、新加坡、日本、英國、澳大利亞、以色列、印度等。基礎層企業美國有33家,中國有14家;技術層企業數量,美國有586家,中國273家;應用層企業美國有488家,中國有304家。

京公網安備 11010502049343號

京公網安備 11010502049343號