編者按:當(dāng)醫(yī)學(xué)從治療轉(zhuǎn)向“終結(jié)死亡”,當(dāng)基因的編輯如整容一樣普及……生物科技將如何改變我們的未來(lái)?這是法國(guó)前教育部部長(zhǎng)、哲學(xué)家呂克·費(fèi)希在新書《超人類革命》中探討的命題。他從道德、哲學(xué)、政治等角度,為這一目前鮮為人知的領(lǐng)域,給出了一種如何面對(duì)技術(shù)進(jìn)步的見(jiàn)解。經(jīng)授權(quán),第一財(cái)經(jīng)節(jié)選部分內(nèi)容與讀者分享。

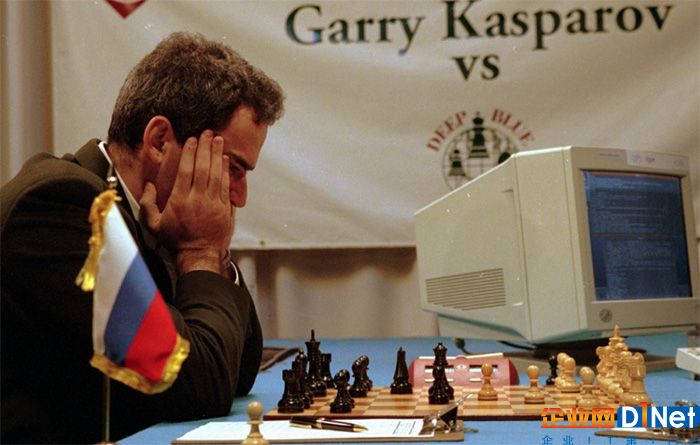

1997年IBM深藍(lán)戰(zhàn)勝了人類國(guó)際象棋冠軍 來(lái)源網(wǎng)絡(luò)簡(jiǎn)單解釋一下“NBIC”最后一個(gè)縮寫字母“C”,即認(rèn)知科學(xué)。在這里,我們必須區(qū)分清楚什么是已經(jīng)成為現(xiàn)實(shí)的所謂低級(jí)人工智能(AI),什么是依舊存在于幻想之中的高級(jí)人工智能(在我看來(lái)永遠(yuǎn)都無(wú)法實(shí)現(xiàn),而大部分人工智能專家和我有著不一樣的觀點(diǎn))。粗略地說(shuō),高級(jí)人工智能是一個(gè)高級(jí)智能機(jī)器所具有的智能,這個(gè)機(jī)器不僅能夠模仿人類智慧的外在形式,而且確確實(shí)實(shí)具備兩種到目前為止有且僅有人類具備的東西(或者說(shuō)至少只存在于智商較高的生物體中,比如猿和高等動(dòng)物可能也具備這兩樣,只不過(guò)其水平較人類低一些):自我意識(shí)和情感——愛(ài)恨、恐懼、痛苦和快樂(lè)等。

低級(jí)人工智能僅停留在解決問(wèn)題的層次上。它可以模仿人類的智慧,但僅僅是機(jī)械模仿,是純粹對(duì)其外在形式的模仿。到目前為止,仍然沒(méi)有電腦能通過(guò)著名的“圖靈測(cè)試”,這就是證明。圖靈測(cè)試是英國(guó)數(shù)學(xué)家設(shè)計(jì)的,在實(shí)驗(yàn)中,一個(gè)人與另一個(gè)他不知道是計(jì)算機(jī)還是人類的“隱藏”實(shí)體進(jìn)行對(duì)話。計(jì)算機(jī)可以模仿人類的對(duì)話,但充其量就是一個(gè)糟糕的精神分析學(xué)家,聽(tīng)到“媽媽”這個(gè)詞,就對(duì)您說(shuō)“您的媽媽,哦,當(dāng)然,您可以隨意聯(lián)想任何東西”諸如此類的話。對(duì)話進(jìn)行一段時(shí)間之后,電腦顯得越來(lái)越古怪,越來(lái)越愚蠢(必須承認(rèn)),即使是最天真的參與者也會(huì)意識(shí)到他是在和一臺(tái)機(jī)器進(jìn)行對(duì)話,從而結(jié)束這個(gè)測(cè)試。

盡管如此,大多數(shù)認(rèn)知科學(xué)家相信,終有一天我們會(huì)成功制造出類似于人腦的機(jī)器,電腦自己可能會(huì)有意識(shí),還可以產(chǎn)生情感,然而很多生物學(xué)家認(rèn)為必須擁有活的身體才能擁有這兩個(gè)屬性。我們先驗(yàn)地傾向于支持生物學(xué)家的觀點(diǎn),除了少數(shù)高級(jí)人工智能的擁護(hù)者。他們稱大腦本身只是一臺(tái)機(jī)器,和其他機(jī)器沒(méi)有區(qū)別,只是更復(fù)雜而已,不過(guò)是由有機(jī)材料構(gòu)成,總有一天我們可以完完全全地復(fù)制出來(lái),甚至將人與機(jī)器結(jié)合。這種結(jié)合技術(shù)正在成為現(xiàn)實(shí),比如人工心臟,它確實(shí)是一個(gè)機(jī)器,但其表面包裹著生物組織。

因此他們產(chǎn)生了以下想法(在我看來(lái)是幻想):某一天智力和記憶也許能夠存儲(chǔ)在一種U盤里(或者幾十年之后出現(xiàn)的類似產(chǎn)品),從而制造出真正的智能機(jī)器,也就是說(shuō),有自我意識(shí)和情感的機(jī)器。我們可以看到,一個(gè)從低級(jí)人工智能悄悄走向高級(jí)人工智能的烏托邦式幻想就這樣出現(xiàn)在數(shù)學(xué)家、計(jì)算機(jī)專家的世界里。因?yàn)椋瑱C(jī)器現(xiàn)在可以做到,至少他們這么認(rèn)為,人類可以做的幾乎一切事情:它們是自主的,其自主程度差不多和人類一樣,它們可以做出決定、學(xué)習(xí)、改正自己的錯(cuò)誤、復(fù)制,很快就(變成烏托邦式幻想)會(huì)成功通過(guò)圖靈測(cè)試。因此,庫(kù)茲韋爾提出,人類可以與這些新的實(shí)體結(jié)合,從而實(shí)現(xiàn)長(zhǎng)生不老。

當(dāng)然,如果我們只是簡(jiǎn)單地從從“外部”來(lái)判斷這些機(jī)器,他們與真實(shí)的人類之間的區(qū)別可能有一天會(huì)難以分辨,甚至根本無(wú)從分辨。雖然目前還不是這樣的情況,也不是沒(méi)有可能有一臺(tái)機(jī)器會(huì)在某一天成功通過(guò)圖靈測(cè)試。但是,什么能夠向我們證明這些機(jī)器具有“真正”的自我意識(shí),有“真正的”情感——愛(ài)恨、歡樂(lè)與痛苦?機(jī)器模仿人類模仿到完美無(wú)缺也不能證明它不只是一個(gè)復(fù)制品。除非陷入被害妄想,否則聲稱這些機(jī)器有情感,但是它們卻無(wú)法證明這一點(diǎn)實(shí)在很荒謬。盡管這些機(jī)器可以完美地模仿生命,它們也并沒(méi)有生命,還比不過(guò)一只不知道自己在說(shuō)什么的鸚鵡。有人說(shuō),大腦本身只是一臺(tái)機(jī)器,剩下的是存在于大腦外部的思維。有一點(diǎn)需要弄清楚:必須要有一個(gè)大腦,還得是一個(gè)聰明的大腦,才能像牛頓一樣發(fā)現(xiàn)萬(wàn)有引力。這個(gè)定律并不存在于我們的頭腦中,它是被我們發(fā)現(xiàn)的,不是由我們發(fā)明或者創(chuàng)造出的,而是確確實(shí)實(shí)存在的。

其實(shí),在20世紀(jì)初,沒(méi)有誰(shuí)會(huì)打賭,哪怕只賭一分錢,說(shuō)一臺(tái)機(jī)器能夠在國(guó)際象棋比賽中擊敗世界上最好的選手。這本來(lái)似乎是一個(gè)不太好笑的玩笑,幼稚的夢(mèng)想,甚至可以被寫進(jìn)儒勒·凡爾納的科幻小說(shuō)。可是……自從這臺(tái)名為“深藍(lán)”的電腦在國(guó)際象棋比賽中奪得了世界冠軍,我們知道了這是可能的。現(xiàn)在,除此之外,您電腦上的任何應(yīng)用程序或者低配置智能手機(jī)的程序都能夠做同樣的事情!還有更多的例子表明低級(jí)人工智能領(lǐng)域在過(guò)去幾年取得了非常大的進(jìn)步。IBM設(shè)計(jì)的計(jì)算機(jī)取了一個(gè)叫沃森的名字,在2011年高調(diào)地參加了著名電視競(jìng)技節(jié)目《危險(xiǎn)邊緣》——在美國(guó)風(fēng)靡一時(shí)的節(jié)目,并打敗了兩個(gè)冠軍。對(duì)一臺(tái)機(jī)器來(lái)說(shuō),這是一個(gè)令人難以置信的挑戰(zhàn):找到對(duì)應(yīng)于自然語(yǔ)言編寫的答案的問(wèn)題(問(wèn)題是用英語(yǔ)描述的)。通過(guò)使用Hadoop的軟件(大數(shù)據(jù)處理軟件),沃森已經(jīng)能夠全速處理兩億頁(yè)的文字,這讓它得以戰(zhàn)勝其競(jìng)爭(zhēng)對(duì)手——人類。有必要說(shuō)明,它不僅能正確地“理解”問(wèn)題,而且可以在幾秒鐘內(nèi)讀完所有的文章,這對(duì)人類來(lái)說(shuō)要花費(fèi)幾輩子的時(shí)間,對(duì)一個(gè)提出的問(wèn)題,它可以提煉出更多合適的答案(想象一下這個(gè)挑戰(zhàn)有多艱巨:找到主持人給的答案背后的問(wèn)題)。它的表現(xiàn)簡(jiǎn)直令人嘆為觀止。盡管我們?nèi)匀幌嘈牛呒?jí)人工智能只是一個(gè)烏托邦,但低級(jí)人工智能目前也已經(jīng)遠(yuǎn)遠(yuǎn)超過(guò)人類的智能,帶來(lái)許多現(xiàn)實(shí)問(wèn)題。就像我提到的一封公開(kāi)信中所講的一樣,這封信是由埃隆·馬斯克、史蒂芬·霍金和比爾·蓋茨簽署的請(qǐng)?jiān)笗荚诜磳?duì)制造和使用著名的“殺手機(jī)器人”軍隊(duì)。這份請(qǐng)?jiān)笗婕笆澜缟蠀⑴c這項(xiàng)研究的上千位研究人員。

這三位對(duì)科學(xué)和新技術(shù)滿懷無(wú)限激情的人提醒我們關(guān)注無(wú)人駕駛飛機(jī)和遠(yuǎn)程操控導(dǎo)彈的危險(xiǎn)。它們,通過(guò)遙控,用人來(lái)操控一些所謂的“高智商”的殺手機(jī)器人,能夠自行決定是否“按下按鈕”來(lái)結(jié)束一個(gè)人的生命。在信中,三位科學(xué)家或者說(shuō)企業(yè)家提出了贊成和反對(duì)這些機(jī)器人的論據(jù)。他們承認(rèn),機(jī)器人可以在戰(zhàn)爭(zhēng)中投入使用從而代替人類,避免不必要的損失。但他們也說(shuō),危險(xiǎn)是巨大的,大于它給人類帶來(lái)的益處:

機(jī)器人的制作成本低廉,不需要稀有材料,這和原子彈不同,這種武器將很快被普及。不久,我們就可以在黑市上發(fā)現(xiàn)它,恐怖分子可以輕而易舉獲得它,獨(dú)裁者可以通過(guò)它來(lái)奴役本國(guó)人民,軍閥統(tǒng)治者可以通過(guò)它來(lái)進(jìn)行種族滅絕,等等。

這就是我們的三個(gè)同類發(fā)出的警告,值得一聽(tīng)。

首先,讓我們來(lái)聽(tīng)一下比爾·蓋茨先生的原話:“我是對(duì)超級(jí)智能的發(fā)展保持擔(dān)憂的人之一。目前,那些在我們的位置替代我們勞動(dòng)、并完成許多任務(wù)的機(jī)器并不是超級(jí)智能。如果我們能夠很好地進(jìn)行管理,像這樣的發(fā)展會(huì)變得越來(lái)越好。然而幾十年之后,智能會(huì)帶來(lái)新的問(wèn)題。我十分同意埃隆·馬斯克的觀點(diǎn),但不明白為什么目前人們對(duì)這個(gè)問(wèn)題并不擔(dān)心。”

史蒂芬·霍金強(qiáng)調(diào)道:“成功地創(chuàng)造出人工智能是人類歷史上偉大的進(jìn)步。但,這極有可能是人類文明最后的進(jìn)步。”

為什么是最后的呢?因?yàn)樗械囊磺卸际歉鶕?jù)達(dá)爾文的進(jìn)化論選擇而來(lái)的,智力也是,但在霍金的假設(shè)里,機(jī)器存在想要繼續(xù)活下去的欲望,所以要消滅一切對(duì)它生命構(gòu)成威脅的事物。既然存在這些智商超群的機(jī)器人,就像科幻電影里描繪的那樣,能夠在幾秒鐘之內(nèi)讀取百萬(wàn)頁(yè),知道我們所有的信息,知道只有我們?nèi)祟愑心芰⑺麄兊碾娫辞袛啵虼俗匀欢唬覀儗?huì)成為他們的頭號(hào)敵人。一旦機(jī)器人控制了所有的信息服務(wù)器,也就是武器,它們將會(huì)變得有能力摧毀我們。

最后,我們來(lái)看看特斯拉公司CEO、絕頂聰明的埃隆·馬斯克說(shuō)了什么:“我認(rèn)為我們應(yīng)該非常小心謹(jǐn)慎。如果讓我猜測(cè)什么最有可能對(duì)我們的生存造成威脅,我會(huì)說(shuō)可能是人工智能。我越來(lái)越傾向于人工智能應(yīng)該被監(jiān)管這個(gè)觀點(diǎn),包括國(guó)家層面和國(guó)際層面上的,以確保我們沒(méi)有在干蠢事。開(kāi)發(fā)人工智能,相當(dāng)于在召喚惡魔。”

馬斯克言行合一,出資1000萬(wàn)美元給一個(gè)致力于人工智能領(lǐng)域安全性研究的基金,這告訴我們,制定人工智能的監(jiān)管規(guī)范對(duì)人類自身的安全來(lái)說(shuō)至關(guān)重要。

京公網(wǎng)安備 11010502049343號(hào)

京公網(wǎng)安備 11010502049343號(hào)