微軟的Copilot被稱為世界上最強大的生產力工具之一。

Copilot是一個AI助手,它位于你的每個Microsoft 365應用程序中-Word、Excel、PowerPoint、Teams、Outlook等。微軟的夢想是從日常工作中解脫出來,讓人類專注于成為創造性的問題解決者。

讓Copilot成為一個不同于ChatGPT和其他AI工具的工具的是,它可以訪問你在365中所做的一切,Copilot可以立即從你的文檔、演示文稿、電子郵件、日歷、筆記和聯系人中搜索和匯編數據,這就是信息安全團隊認為存在的問題,Copilot可以訪問用戶可以訪問的所有敏感數據。平均而言,一家公司10%的M365數據對所有員工開放。

Copilot還可以快速生成必須保護的全新敏感數據。在AI革命之前,人類創建和共享數據的能力遠遠超過了保護數據的能力,只要看看數據泄露的趨勢就知道了,GenAI為這把火加了一把油。

作為一個整體,當談到GenAI時,有很多東西需要拆解:模型中毒、幻覺、深度假冒等,然而,在這篇文章中,我將專門關注數據安全以及你的團隊如何確保安全的Copilot推出。

Microsoft 365 Copilot的使用案例

GenAI與M365這樣的協作套件的使用案例是無限的,很容易理解為什么這么多IT和安全團隊都在叫囂著要及早訪問并準備他們的推廣計劃,生產率的提升將是巨大的。

例如,你可以打開一個空白Word文檔,并要求Copilot根據目標數據集為客戶起草一份建議書,目標數據集可以包括OneNote頁面、PowerPoint幻燈片和其他辦公文檔,在幾秒鐘內,你就有了一個完整的提案。

以下是微軟在發布會活動中給出的更多例子:

·Copilot可以參加你的Teams會議,實時總結正在討論的內容,捕捉行動項目,并告訴你哪些問題在會議中未得到解決。

·Outlook中的Copilot可以幫助你對收件箱進行分類、確定電子郵件的優先順序、匯總主題并為你生成回復。

·Excel中的Copilot可以分析原始數據,為你提供見解、趨勢和建議。

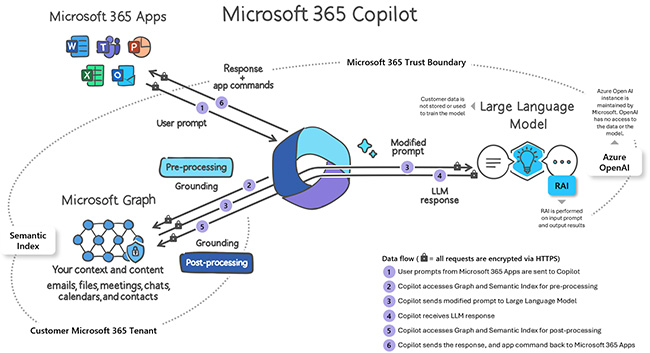

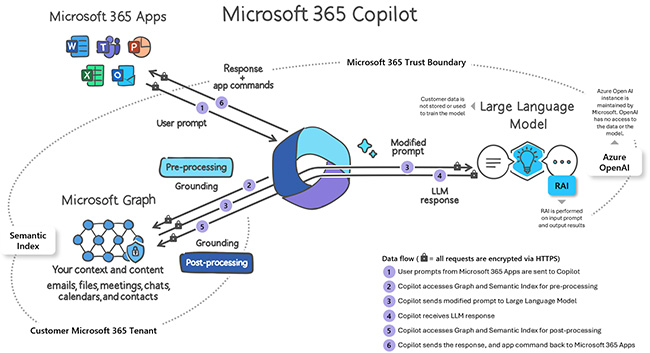

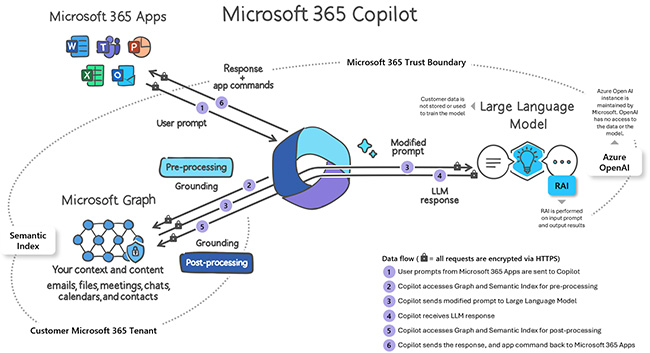

Microsoft 365 Copilot的工作原理

以下是Copilot提示處理方式的簡單概述:

·用戶在Word、Outlook或PowerPoint等應用程序中輸入提示。

·微軟根據用戶的M365權限收集用戶的業務環境。

·向LLM(如GPT4)發送提示以生成響應。

·微軟執行負責任的AI后處理檢查。

·微軟向M365應用程序返回一個響應和命令。

Microsoft 365 Copilot的安全模型

在微軟,生產力和安全性之間總是存在著極端的緊張關系。

這一點在冠狀病毒期間表現得淋漓盡致,當時IT團隊在沒有完全了解底層安全模型如何工作或組織的M365權限、組和鏈接策略如何形成的情況下,就迅速部署了Microsoft Teams。

好消息是:

·租戶隔離。Copilot僅使用來自當前用戶的M365租戶的數據,AI工具不會顯示來自用戶可能是訪客的其他租戶的數據,也不會顯示可能設置了跨租戶同步的任何租戶的數據。

·培訓范圍。Copilot不會使用你的任何業務數據來培訓Copilot為所有租戶使用的基礎LLM,你不用擔心你的專有數據會出現在其他租戶的其他用戶的回復中。

壞消息是:

·權限。Copilot顯示個人用戶至少具有查看權限的所有組織數據。

·Copilot生成的內容不會繼承Copilot響應來源的文件的MPIP標簽。

·Copilot的回應不能保證100%真實或安全,人類必須對審查AI生成的內容負責。

讓我們把缺點一個接一個地詳細說出來。

權限

如果公司能夠輕松地在Microsoft 365中強制實施最低特權,那么將Copilot訪問權限僅授予用戶可以訪問的內容將是一個很好的想法。

微軟在其Copilot數據安全文檔中指出:

請務必使用Microsoft 365服務中提供的權限模式(如SharePoint),以幫助確保正確的用戶或組能夠正確訪問企業中的正確內容。

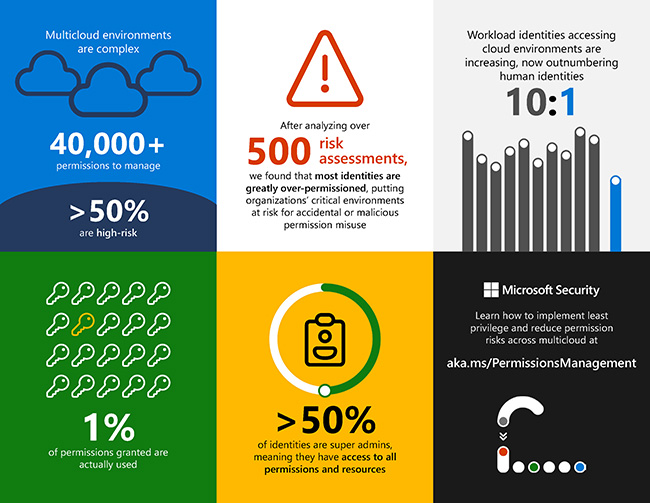

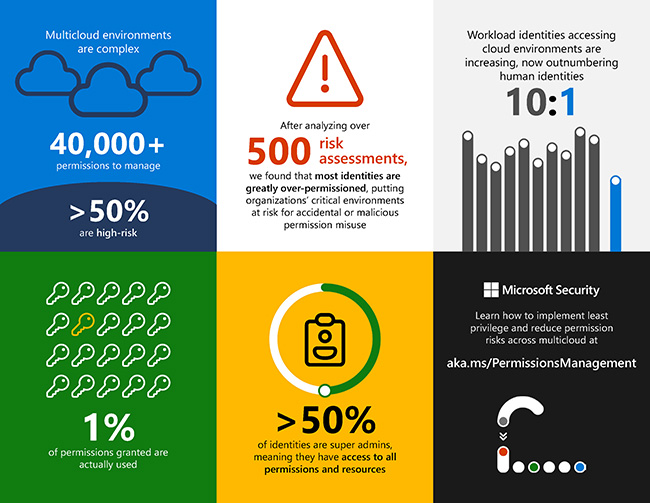

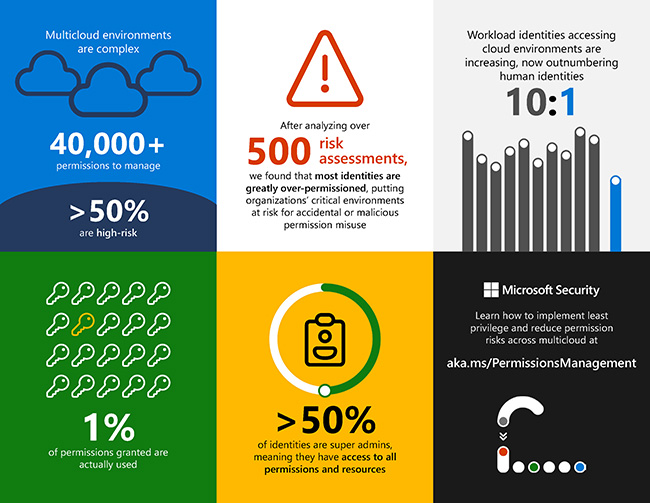

然而,我們從經驗上知道,大多數企業都遠遠談不上享有最低特權,看看微軟自己的云權限狀態風險報告中的一些統計數據就知道了。

這張圖片與我們每年對使用Microsoft 365的公司執行數千次數據風險評估時Varonis看到的情況相吻合。在我們的報告中,我們發現M365租戶平均擁有:

·4000多萬個唯一權限

·11.3萬多條公開共享的敏感記錄

·27K+共享鏈接

這一切為什么要發生?Microsoft 365權限極其復雜,只需考慮一下用戶可以訪問數據的所有方式:

·直接用戶權限

·Microsoft 365組權限

·SharePoint本地權限(具有自定義級別)

·訪客訪問

·外部訪問

·公眾通道

·鏈接訪問(任何人、組織范圍內、直接訪問、訪客)

更糟糕的是,權限主要掌握在最終用戶手中,而不是IT或安全團隊。

標簽

微軟在很大程度上依賴敏感標簽來執行DLP策略、應用加密和廣泛防止數據泄露,然而,在實踐中,讓標簽發揮作用是困難的,特別是如果你依賴人類來貼敏感標簽的話。

微軟描繪了一幅美好的圖景,將標簽和屏蔽作為數據的最終安全網,現實揭示了一種更糟糕的情景,隨著人類創造數據,標簽往往落后或過時。

阻止或加密數據可能會增加工作流的摩擦,而標記技術僅限于特定的文件類型,一個企業擁有的標簽越多,它對用戶來說就越令人困惑,對于較大的企業來說,這一點尤其強烈。

當AI生成更多需要準確和自動更新標簽的數據時,基于標簽的數據保護的效率肯定會下降。

我的標簽沒問題吧?

Varonis可以通過掃描、發現和修復以下內容來驗證和改進組織的Microsoft敏感度標簽:

·沒有標簽的敏感文件

·標簽不正確的敏感文件

·帶有敏感標簽的非敏感文件

人類

AI可以讓人類變得懶惰,像GPT4這樣的LLM生成的內容不僅很好,而且很棒,在許多情況下,速度和質量都遠遠超過了人類的能力,因此,人們開始盲目信任AI來創造安全和準確的響應。

我們已經看到了現實世界中的場景,在這些場景中,Copilot為客戶起草了一份建議書,其中包括屬于完全不同客戶的敏感數據,用戶快速掃一眼(或不掃一眼)后點擊“發送”,現在你就有了隱私或數據泄露的場景。

讓你的租戶安全-為Copilot做好準備

在你的Copilot推出之前,對你的數據安全態勢有一個感覺是至關重要的。現在,Copilot已基本可用,現在正是設置安全控制的好時機。

最好的方法是從免費的風險評估開始,只需幾分鐘即可完成設置,一兩天之內,你就可以實時了解敏感數據風險。

關于企業網D1net(hfnxjk.com):

國內主流的to B IT門戶,同時在運營國內最大的甲方CIO專家庫和智力輸出及社交平臺-信眾智(www.cioall.com)。同時運營19個IT行業公眾號(微信搜索D1net即可關注)。

版權聲明:本文為企業網D1Net編譯,轉載需在文章開頭注明出處為:企業網D1Net,如果不注明出處,企業網D1Net將保留追究其法律責任的權利。

掃一掃

掃一掃

京公網安備 11010502049343號

京公網安備 11010502049343號