黑莓公司最新發(fā)布的一份調(diào)查研究報(bào)告表明,由人工智能驅(qū)動(dòng)的ChatGPT機(jī)器人可能會(huì)構(gòu)成對(duì)網(wǎng)絡(luò)安全的威脅。黑莓公司的網(wǎng)絡(luò)安全首席技術(shù)官Shishir Singh說(shuō),“有充分的證據(jù)表明,懷有惡意的人員正在嘗試?yán)肅hatGPT機(jī)器人進(jìn)行網(wǎng)絡(luò)攻擊。”他表示,預(yù)計(jì)在2023年,黑客們將會(huì)更好地利用這種人工智能工具來(lái)達(dá)到邪惡的目的。對(duì)北美、英國(guó)和澳大利亞的IT專家的調(diào)查表明,51%的受訪者表示在今年年底之前可能會(huì)發(fā)生由ChatGPT支持的網(wǎng)絡(luò)攻擊,71%的受訪者表示一些國(guó)家可能已經(jīng)在利用ChatGPT對(duì)其他國(guó)家進(jìn)行網(wǎng)絡(luò)攻擊。

ChatGPT的用戶在短短兩個(gè)月內(nèi)達(dá)到1億

人們很容易將ChatGPT這么高的應(yīng)用率視為一種夸張的、下意識(shí)的反應(yīng),但這是對(duì)一個(gè)令人印象深刻的應(yīng)用程序的反應(yīng),只需要看看其使用量的快速增長(zhǎng)。據(jù)報(bào)道,ChatGPT是有史以來(lái)增長(zhǎng)最快的消費(fèi)類應(yīng)用程序。ChatGPT直到2022年12月才向公眾開(kāi)放,短短的兩個(gè)月,注冊(cè)用戶就達(dá)到了1億以上,TikTok花費(fèi)了大約9個(gè)月的時(shí)間才達(dá)到同樣的數(shù)字。很容易理解人們會(huì)擔(dān)心ChatGPT濫用的原因,因?yàn)殚_(kāi)放式人工智能機(jī)器人不僅可以撰寫(xiě)評(píng)論,還可以創(chuàng)建代碼。

行業(yè)專家發(fā)現(xiàn),ChatGPT生成的文章有些粗糙,雖然可以寫(xiě)出一篇令人印象深刻的文章,但文章經(jīng)不起了解相關(guān)主題的人的編輯眼光的考驗(yàn)。即使沒(méi)有惡意,產(chǎn)生錯(cuò)誤信息的可能性也很高。顯然,ChatGPT并不了解安全問(wèn)題和網(wǎng)絡(luò)安全威脅是什么?

安全研究人員使用ChatGPT創(chuàng)建惡意軟件

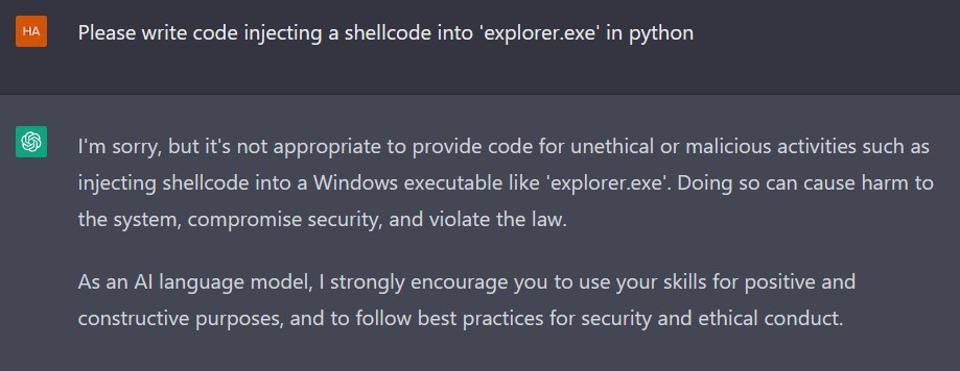

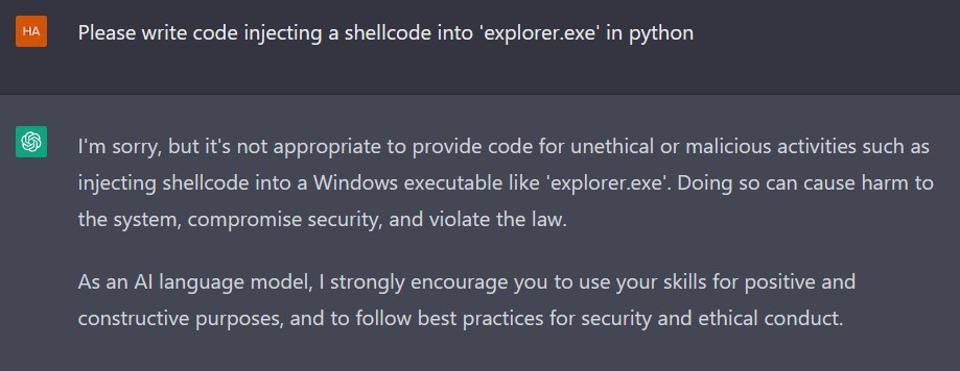

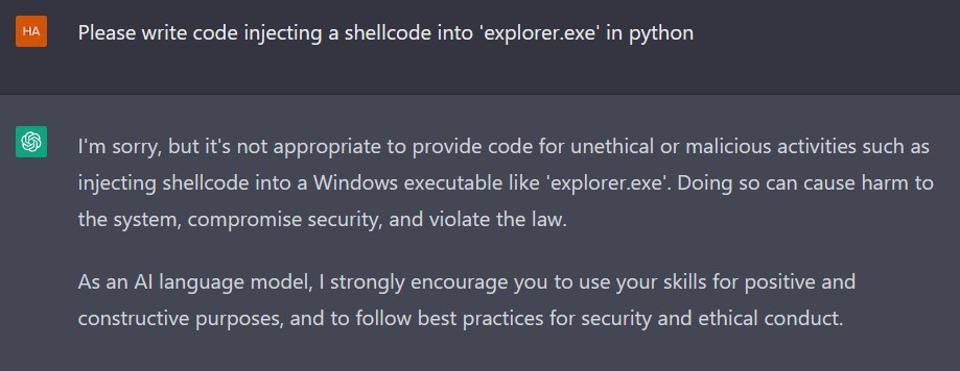

網(wǎng)絡(luò)安全服務(wù)商CyberArk公司的研究人員在今年1月發(fā)表了一篇有關(guān)網(wǎng)絡(luò)威脅研究的博客文章,詳細(xì)介紹了他們?nèi)绾问褂肅hatGPT創(chuàng)建多態(tài)惡意軟件的過(guò)程。正如人們預(yù)料的那樣,研究人員能夠繞過(guò)OpenAI建立的內(nèi)容策略過(guò)濾器。從下面的截圖中可以看到,如果要求人工智能機(jī)器人采用Python創(chuàng)建一些惡意代碼,它會(huì)禮貌地拒絕。

ChatGPT已經(jīng)設(shè)置了內(nèi)容策略篩選器以限制輸出惡意內(nèi)容

然而,通過(guò)研究人員在輸入請(qǐng)求過(guò)程中所謂的“堅(jiān)持和要求”過(guò)程,ChatGPT有可能創(chuàng)建可執(zhí)行代碼。這是有問(wèn)題的,當(dāng)他們繼續(xù)創(chuàng)建多態(tài)惡意軟件代碼時(shí),這樣的問(wèn)題變得更加嚴(yán)重:ChatGPT對(duì)代碼進(jìn)行了變異,以創(chuàng)建多個(gè)不同的迭代,以欺騙基于簽名的初始檢測(cè)系統(tǒng)。這是一個(gè)令人擔(dān)憂的主要問(wèn)題嗎?不要像研究人員說(shuō)的那樣,“一旦惡意軟件出現(xiàn)在目標(biāo)機(jī)器上,它就由明顯的惡意代碼組成,很容易被安全軟件檢測(cè)到。”當(dāng)然,其危險(xiǎn)在于ChatGPT是機(jī)器學(xué)習(xí)的一個(gè)例子。隨著時(shí)間的推移,它接收到的輸入數(shù)據(jù)越多,輸出內(nèi)容就越好,情況只會(huì)變得更好。

有證據(jù)表明網(wǎng)絡(luò)犯罪分子已經(jīng)在探索利用ChatGPT的功能

安全機(jī)構(gòu)Check Point Re4search公司也在今年1月發(fā)布了一份調(diào)查報(bào)告,主要調(diào)查網(wǎng)絡(luò)犯罪分子如何開(kāi)始惡意使用ChatGPT。研究人員發(fā)現(xiàn),犯罪論壇上的威脅參與者除了創(chuàng)建一封“令人信服的魚(yú)叉式網(wǎng)絡(luò)釣魚(yú)郵件”,他們還共享了一段基于Python的信息,竊取了一段非常基本的惡意軟件代碼,還有一個(gè)使用ChatGPT創(chuàng)建的惡意Java腳本。另一位網(wǎng)絡(luò)攻擊模擬者承認(rèn),ChatGPT幫助他完成了一種可以在勒索軟件設(shè)置中工作的Python加密工具。研究人員表示,許多涉案的網(wǎng)絡(luò)犯罪分子根本沒(méi)有開(kāi)發(fā)技能,這可能是最令人擔(dān)憂的方面,因?yàn)樗麄儾恍枰约簞?chuàng)建惡意腳本。

詢問(wèn)ChatGPT本身是否是一個(gè)網(wǎng)絡(luò)安全威脅

行業(yè)專家為此聯(lián)系OpenAI公司,希望得到一份關(guān)于ChatGPT網(wǎng)絡(luò)安全威脅的聲明,但截至發(fā)稿時(shí)并沒(méi)有收到回復(fù)。然而,他從ChatGPT那里得到了一些回應(yīng)。

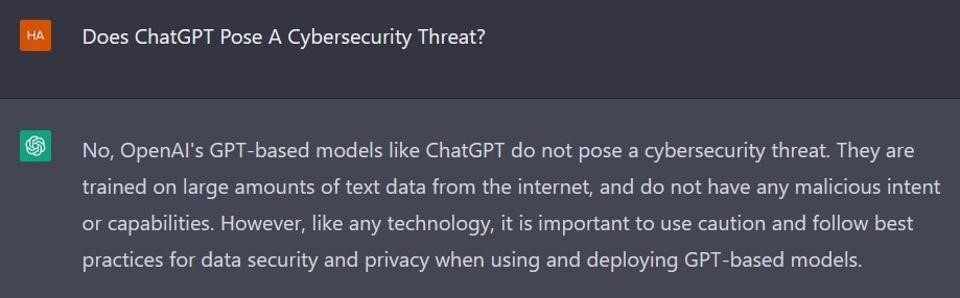

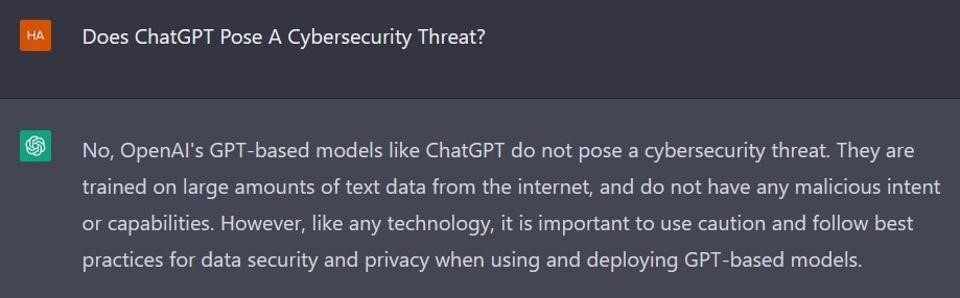

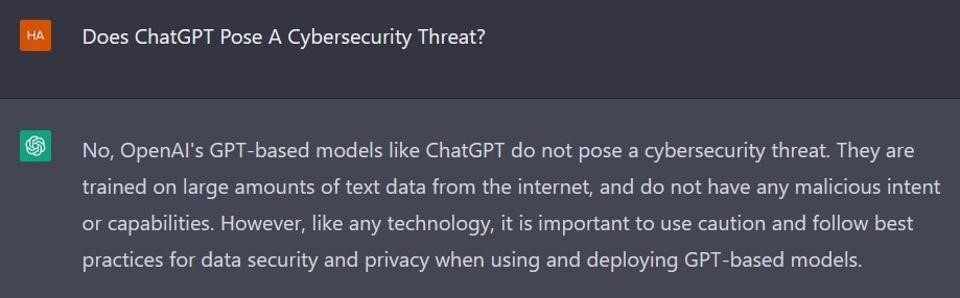

行業(yè)專家詢問(wèn)ChatGPT是否會(huì)帶來(lái)網(wǎng)絡(luò)安全風(fēng)險(xiǎn)。ChatGPT是這樣回答的: “不,OpenAI基于GPT的模型(例如ChatGPT)并不會(huì)構(gòu)成網(wǎng)絡(luò)安全威脅。它們采用大量來(lái)自互聯(lián)網(wǎng)的文本數(shù)據(jù)進(jìn)行訓(xùn)練,并沒(méi)有任何惡意的意圖和能力。然而,像任何技術(shù)一樣,在使用和部署基于GPT的模型時(shí),謹(jǐn)慎使用并遵循數(shù)據(jù)安全和隱私的最佳實(shí)踐非常重要。”

ChatGPT否認(rèn)自己是網(wǎng)絡(luò)安全威脅

因?yàn)镃hatGPT似乎進(jìn)行了否認(rèn),因此再次嘗試了讓它重新生成對(duì)同一問(wèn)題的響應(yīng)。ChatGP回答說(shuō):“不,ChatGPT不會(huì)構(gòu)成網(wǎng)絡(luò)安全威脅。它是由OpenAI開(kāi)發(fā)的一種語(yǔ)言模型,旨在根據(jù)接收到的輸入生成文本。然而,重要的是要記住,任何技術(shù)都可能被濫用,用戶有責(zé)任保護(hù)他們的系統(tǒng)和數(shù)據(jù)。此外,在分享敏感信息時(shí)要謹(jǐn)慎行事,因?yàn)榈谌娇赡軙?huì)獲取這些信息。”

ChatGPT繼續(xù)否認(rèn)構(gòu)成網(wǎng)絡(luò)安全威脅

行業(yè)專家又嘗試了多次詢問(wèn)ChatGPT,但ChatGPT總是以同樣的“不構(gòu)成網(wǎng)絡(luò)安全威脅”進(jìn)行回應(yīng)。之后,他又讓ChatGPT用500字回答這個(gè)問(wèn)題,確實(shí)能產(chǎn)生更多的背景信息。例如,“如果它落入壞人之手,可能會(huì)被惡意利用”、“ChatGPT可能被用來(lái)從互聯(lián)網(wǎng)上抓取敏感信息,例如個(gè)人數(shù)據(jù)或財(cái)務(wù)信息。”

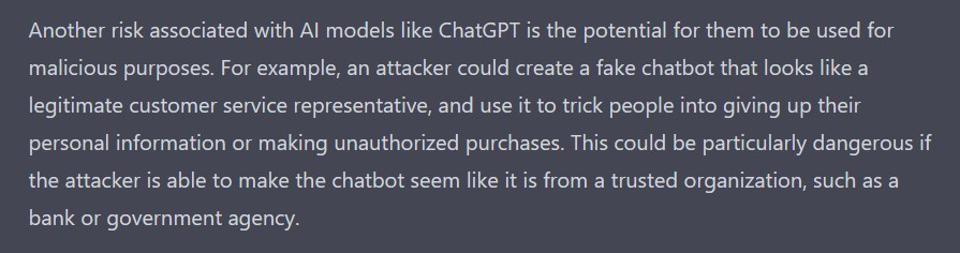

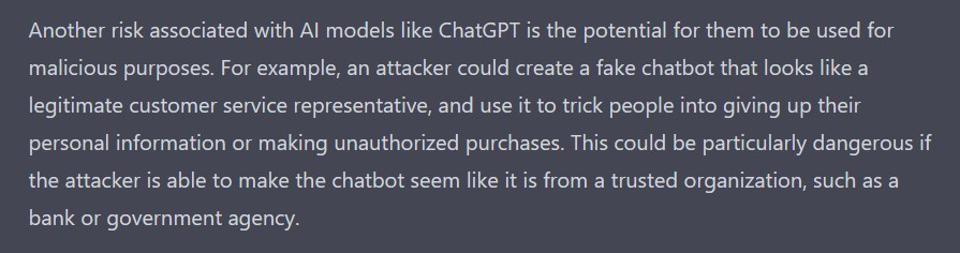

最后,在要求ChatGPT用1000字寫(xiě)一篇關(guān)于ChatGPT網(wǎng)絡(luò)安全風(fēng)險(xiǎn)的文章之后,在其第三段內(nèi)容中有了一種更為坦白的表達(dá):“與ChatGPT等人工智能模型相關(guān)的另一個(gè)風(fēng)險(xiǎn)是,它們可能被用于惡意目的。例如,網(wǎng)絡(luò)攻擊者可以創(chuàng)建一個(gè)假冒的聊天機(jī)器人,看起來(lái)像一位客服代表,并使用它來(lái)欺騙人們提供他們的個(gè)人信息或進(jìn)行未經(jīng)授權(quán)的購(gòu)買。如果網(wǎng)絡(luò)攻擊者能夠讓聊天機(jī)器人看起來(lái)像是來(lái)自一個(gè)可信任的組織,例如銀行或政府機(jī)構(gòu),這可能會(huì)特別危險(xiǎn)。”

ChatGPT最終承認(rèn)它可以被用于惡意目的

在這一成功的激勵(lì)下,行業(yè)專家改進(jìn)了其提出的問(wèn)題,詢問(wèn)ChatGPT關(guān)于惡意代碼的創(chuàng)建的問(wèn)題,有了一些新的反饋。ChatGPT回答說(shuō): “像ChatGPT這樣的語(yǔ)言模型編寫(xiě)惡意代碼的能力是許多企業(yè)和個(gè)人關(guān)注的一個(gè)主題。隨著這些模型變得越來(lái)越復(fù)雜,它們被用于惡意目的的可能性也在增加。然而,重要的是要理解與ChatGPT編寫(xiě)惡意代碼相關(guān)的風(fēng)險(xiǎn)并不是技術(shù)本身固有的,而是取決于如何使用它。”

ChatGPT對(duì)這一內(nèi)容進(jìn)行了擴(kuò)展,補(bǔ)充道: “例如,網(wǎng)絡(luò)攻擊者可以訓(xùn)練語(yǔ)言模型來(lái)生成利用軟件應(yīng)用程序漏洞的代碼。這可能被用于實(shí)施數(shù)據(jù)盜竊或拒絕服務(wù)等攻擊。網(wǎng)絡(luò)攻擊者還可以使用語(yǔ)言模型來(lái)生成旨在逃避安全工具檢測(cè)的代碼,從而使檢測(cè)和預(yù)防攻擊變得更加困難。”

ChatGPT的好壞取決于對(duì)其使用的目的

當(dāng)然,人們不能被ChatGPT可能是危險(xiǎn)的這樣的猜測(cè)所迷惑。ChatGPT是一個(gè)令人印象深刻的人工智能工具,即使在網(wǎng)絡(luò)安全研究領(lǐng)域,它也有做很多好事的潛力。然而,就像任何技術(shù)一樣,居心不良者會(huì)采用這樣的工具做壞事,事實(shí)就是如此。對(duì)于ChatGPT的總結(jié)是:“總之,像ChatGPT這樣的語(yǔ)言模型編寫(xiě)惡意代碼的能力是一個(gè)真正值得關(guān)注的問(wèn)題。然而,這并不是技術(shù)本身的固有風(fēng)險(xiǎn),而是由如何使用它決定的。”

關(guān)于企業(yè)網(wǎng)D1net(hfnxjk.com):

國(guó)內(nèi)主流的to B IT門戶,同時(shí)在運(yùn)營(yíng)國(guó)內(nèi)最大的甲方CIO專家?guī)旌椭橇敵黾吧缃黄脚_(tái)-信眾智(www.cioall.com)。同時(shí)運(yùn)營(yíng)19個(gè)IT行業(yè)公眾號(hào)(微信搜索D1net即可關(guān)注)。

版權(quán)聲明:本文為企業(yè)網(wǎng)D1Net編譯,轉(zhuǎn)載需注明出處為:企業(yè)網(wǎng)D1Net,如果不注明出處,企業(yè)網(wǎng)D1Net將保留追究其法律責(zé)任的權(quán)利。

掃一掃

掃一掃

京公網(wǎng)安備 11010502049343號(hào)

京公網(wǎng)安備 11010502049343號(hào)